Quando Sriram Krishnan, um assessor sênior da Casa Branca para políticas de inteligência artificial, subiu ao palco em um evento em Washington no mês passado, ele listou as prioridades da administração Trump para avançar a revolução da IA.

No topo da lista? Mais construção.

“Vamos garantir que construamos nossa infraestrutura”, disse Krishnan. “‘Construir, construir, construir’ é o que dizemos às pessoas.”

Esse grito de guerra está ecoando por todo o Vale do Silício. Executivos da Meta dizem esperar gastar US$ 600 bilhões em infraestrutura de IA, incluindo centros de dados de grande porte, até 2028. A OpenAI e a Oracle anunciaram planos de investir US$ 500 bilhões em um projeto de data center apelidado de Stargate, enquanto a Amazon planeja gastar mais de US$ 30 bilhões em despesas de capital, ou capex, em cada um dos próximos dois trimestres.

O problema: o business case para a IA permanece não testado, e não está claro se a receita proveniente de produtos de IA justificará os gastos cada vez maiores. Se justificar, isso pode colocar a economia em uma trajetória de crescimento mais alta e transformar setores inteiros. Se não, o impacto pode remodelar a economia — de quedas no mercado acionário a comunidades deixadas com vastos centros de dados vazios.

No início deste ano, o Business Insider publicou uma investigação sobre a indústria de data centers, criando o mapa mais abrangente até hoje de onde ficam os centros de dados nos EUA. A investigação encontrou 1.240 data centers na América já construídos ou aprovados para construção no fim de 2024, um aumento de quase quatro vezes desde 2010. Os dados não incluíam quaisquer projetos que tenham recebido licenças neste ano.

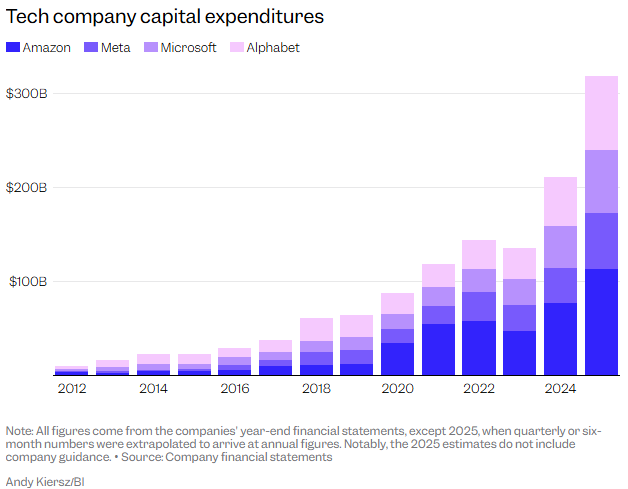

Neste ano, quatro dos cinco maiores consumidores de energia de nossa contagem — Amazon, Meta, Microsoft e Google — podem gastar cerca de US$ 320 bilhões em capex, principalmente para infraestrutura de IA, de acordo com uma análise de demonstrações financeiras feita pelo Business Insider. Isso é mais do que o PIB da Finlândia e quase o total de receita que a ExxonMobil obteve em 2024.

A escala do investimento está despertando preocupações sobre uma bolha e o potencial de um estouro que poderia derrubar o mercado acionário de máximas recordes.

Até agora, as preocupações não assustaram os investidores. O Nasdaq, fortemente ponderado em tecnologia, sobe 19% neste ano, com Nvidia — a maior empresa do mundo por capitalização de mercado —, Google e Microsoft todas em alta de mais de 25%. A Oracle viu suas ações subirem 75% neste ano.

O dinheiro gasto neste ano em infraestrutura e software de IA contribuiu mais para o crescimento do PIB do que o consumo das famílias, segundo a leitura de dados do Bureau of Economic Analysis feita pela Renaissance Macro Research.

É um boom de construção como poucos na memória viva, transformando paisagens, consumindo escassos recursos hídricos e pressionando a já sobrecarregada rede elétrica dos EUA. A ambição pura tem sido comparada ao programa espacial Apollo, ao sistema de rodovias interestaduais de meados do século XX e ao colapso da fibra óptica na virada do século, que deixou quilômetros de “dark fiber” [fibra apagada/sem uso].

Sarah Friar, diretora financeira da OpenAI, destacou recentemente o tamanho das metas do setor, quando falou à margem de uma conferência do Goldman Sachs em setembro. Os gastos com IA, disse ela, não eram como o sistema ferroviário do século XIX — eram como os primeiros dias dele.

“Muita gente comparou a era da IA a coisas como a construção das ferrovias, porque é uma expansão muito intensiva em capital”, disse Friar ao Yahoo Finance. “Acho que estamos apenas começando. Talvez tenhamos assentado alguns trilhos de Nova York a Baltimore, mas, no fim, vamos cobrir os EUA, e, no fim, cobrir o mundo.”

Se a aposta der certo, os retornos podem fazer com que o dinheiro enterrado em data centers pareça pequeno. O boom de data centers se tornaria a base do próximo ciclo de tecnologia, permitindo que Amazon, Microsoft, Google e outros “alugassem” inteligência da mesma forma que alugam armazenamento em nuvem hoje. Agents de IA e modelos customizados poderiam formar a base de produtos de assinatura de alta margem e receita recorrente.

Se não der certo? Não procure além das ferrovias. O excesso de investimento em linhas férreas, incluindo a Ferrovia Transcontinental, provocou não uma, mas duas crises bancárias na segunda metade do século XIX. O setor lutou com o excesso de gastos, acabando por deixar investidores — e os bancos que os financiaram — com perdas pesadas.

Apesar do investimento, o business case para a IA ainda não foi testado.

O boom de infraestrutura de IA se apoia em um pressuposto fundamental sobre como as máquinas aprendem melhor. A abordagem envolve alimentar enormes quantidades de dados em large language models [modelos de linguagem de grande porte], que então buscam padrões, ou sinais, enterrados no ruído. Para melhorar, diz a teoria, os modelos precisam ingerir e analisar quantidades crescentes de dados, o que exige cada vez mais poder computacional.

Essa necessidade de escala moldou o cenário competitivo. Se modelos melhores dependem de mais poder de computação, o próximo passo óbvio é garantir o máximo possível desse recurso. E isso significa mais data centers — grandes galpões repletos de graphics processing units, ou GPUs, que lidam com os cálculos complexos exigidos.

Em um blog recente, o CEO da OpenAI, Sam Altman, imaginou o que poderia ser possível se sistemas de IA tivessem poder computacional virtualmente ilimitado. A IA poderia curar o câncer ou dar a cada aluno na Terra um tutor personalizado. “Se estivermos limitados por compute [capacidade de computação]”, escreveu ele, “teremos de escolher qual priorizar; ninguém quer fazer essa escolha, então vamos construir.”

Gary Marcus, professor emérito de psicologia e neurociência da New York University e crítico declarado da abordagem do Vale do Silício para desenvolver IA, tem argumentado contra a estratégia de que “maior é melhor”. Marcus tem reiterado que a teoria fundamental que impulsiona as Big Techs a construir capacidade de computação — as scaling laws [leis de escala] — está errada.

“O significado da palavra scaling foi amplamente desvalorizado”, escreveu Marcus. “‘Scaling’ costumava significar ‘consigo prever com bastante exatidão quão bem um determinado LLM vai se sair, conhecendo o tamanho de sua base de dados e a quantidade de compute usada no treinamento, e esses aumentos serão exponenciais.’ Não mais”, escreveu.

O lançamento, em agosto, do GPT-5, o modelo mais recente da OpenAI, reforçou o ceticismo de Marcus, já que muitos o perceberam como um passo incremental e um desafio à ideia de que adicionar mais poder computacional produz modelos melhores. Os modelos de linguagem líderes ainda cometem erros simples, ou alucinações, que prejudicam sua confiabilidade. O problema persiste mesmo enquanto as empresas despejam exponencialmente mais poder de computação no treinamento, segundo a Bain & Company.

Empresas com grandes gastos ainda não demonstraram resultados significativos auxiliados por IA, concluíram vários estudos. Pesquisadores do Massachusetts Institute of Technology publicaram um relatório neste verão sugerindo que 95% das primeiras iniciativas corporativas de IA ainda não haviam gerado retorno. As ações de tecnologia caíram brevemente com o relatório, entre outras razões.

Pesquisadores do BetterUp Labs e do Stanford Social Media Lab cunharam o termo “workslop” para descrever o produto de qualidade inferior assistido por IA que cada vez mais funcionários estão produzindo. Como os modelos ainda carecem de precisão e nuance, a tarefa de checar fatos e limpar a saída recai sobre os colegas. Escrevendo na Harvard Business Review, os pesquisadores disseram que 40% dos 1.150 trabalhadores que pesquisaram relataram ter recebido “workslop” de colegas no mês passado.

Com sua utilidade ainda em questão, não está claro quando — ou se — a receita proveniente de produtos de IA justificará os gastos. A Bain estima que, até 2030, o capex anual será de US$ 500 bilhões para atender às necessidades de computação do setor. Para justificar isso, as empresas precisariam gerar US$ 2 trilhões em receita anual, disse a Bain. Isso é cerca de US$ 800 bilhões a mais do que as empresas podem economizar usando IA para tornar vendas, marketing, atendimento ao cliente e P&D mais eficientes. Em outras palavras, concluiu a consultoria, o setor ficará aquém a menos que consiga encontrar novos produtos ou serviços para vender.

Em setembro, Friar, a CFO da OpenAI, disse que a empresa triplicará a receita neste ano para cerca de US$ 13 bilhões. No mesmo mês, a empresa concordou em pagar à Oracle uma média de US$ 60 bilhões por ano por capacidade de data center — quase cinco vezes mais do que espera faturar.

A McKinsey & Company reconheceu, em um relatório de abril sobre capex, a posição difícil em que o setor se encontra: gastar pouco e correr o risco de perder uma tecnologia que pode ser uma das mais transformadoras da história; gastar demais e arriscar desperdiçar dezenas ou centenas de bilhões de dólares.

“As apostas são altas”, escreveu a McKinsey no relatório. “Investir demais em infraestrutura de data centers arrisca imobilizar ativos, enquanto investir de menos significa ficar para trás.”

O CEO da Meta, Mark Zuckerberg, foi mais direto quando admitiu quanto dinheiro estava disposto a desperdiçar para vencer a corrida armamentista da IA. “Se acabarmos gastando mal algumas centenas de bilhões de dólares, acho que isso será muito lamentável”, disse Zuckerberg a um entrevistador de podcast. Ao mesmo tempo, ele destacou o risco de ficar para trás se o uso produtivo de IA ganhar tração.

“Na verdade, acho que o risco é maior do outro lado”, afirmou.

Há um quarto de século, um padrão similar surgiu quando empresas correram para construir a espinha dorsal da internet nascente. Companhias como WorldCom e Global Crossing gastaram dezenas de bilhões de dólares nos cinco anos até 2001 instalando cabos de fibra óptica e outras capacidades de rede, apenas para colapsar no ano seguinte, quando o estouro da bolha dot-com levou os credores que financiaram a construção a exigir seu dinheiro de volta.

Acionistas das empresas que lideraram a expansão da fibra óptica perderam US$ 2 trilhões em valor, enquanto 500.000 trabalhadores perderam seus empregos, de acordo com análise conduzida pela Brookings Institution. Embora o cabo de fibra óptica tenha sido eventualmente utilizado — em grande parte pela revolução do streaming de vídeo pioneira pela Netflix —, muitas das empresas que o instalaram não estavam mais presentes para ver isso.

Assim como os cabos de fibra óptica e as ferrovias de uma era anterior, a construção de data centers e a compra de GPUs estão sendo financiadas por Wall Street.

Parte do dinheiro vem por canais conhecidos. A Oracle vendeu recentemente US$ 18 bilhões em títulos para financiar seus planos de expansão de data centers, enquanto a upstart de data centers CoreWeave, que abriu capital em março, acessou os mercados públicos de dívida e ações em cerca de US$ 25 bilhões desde o ano passado para financiar sua própria expansão.

Cada vez mais, as empresas também recorrem a credores menos tradicionais. A Meta levantou recentemente US$ 29 bilhões para seu mais recente projeto de data center junto a firmas incluindo a Pacific Investment Management Company e a Blue Owl Capital. O acordo permitiu à Meta levantar bilhões sem ter que reportar o valor total em seu balanço.

Quando a CFO da Meta, Susan Li, foi questionada sobre os planos da empresa para métodos de financiamento não tradicionais em uma conferência recente, ela disse que a companhia construiu seus próprios data centers durante a maior parte de sua história. Agora, disse ela, como “a ambição de nossa capacidade de infraestrutura se desenrola à nossa frente, isso meio que ofusca o que construímos antes, e precisamos ser um pouco mais amplos na forma como estamos pensando sobre isso.”

Outros desenvolvedores de data centers estão usando os mercados de títulos securitizados [títulos lastreados em recebíveis de aluguel] para manter o boom. Uma vez que um projeto é construído e alugado, eles transformam a receita de locação em títulos e os vendem a investidores ansiosos por participar do boom da IA. Isso libera mais dinheiro para investir em projetos futuros e alimenta os gastos, mesmo que a demanda por projetos de data center maduros comece a diminuir, disse Paul Kedrosky, blogueiro financeiro e consultor de hedge funds que escreveu recentemente sobre o tema.

“Os desenvolvedores constroem data centers, alugam o acesso para hyperscalers [provedores de hiperescala] e depois empacotam a renda de aluguel em títulos. As receitas são recicladas para a próxima rodada de construção”, escreveu Kedrosky em seu site. “Em suma: o mundo de structured credit [crédito estruturado], não o de real estate equity [capital imobiliário], é quem financia agora o boom dos data centers.”

Cada vez mais, o próprio Vale do Silício está ajudando a financiar o boom. Em setembro, a Nvidia concordou em investir US$ 100 bilhões na OpenAI para ajudar na construção de seus data centers, com a expectativa de que a OpenAI usaria o dinheiro para comprar GPUs da Nvidia para seus centros de dados. A Microsoft investiu na OpenAI cedo, e a OpenAI usou o dinheiro para alugar a capacidade de computação da Microsoft. Na segunda-feira, a fabricante de chips AMD anunciou que a OpenAI concordou em comprar GPUs para fornecer energia a até 6 gigawatts de capacidade de computação em troca de um warrant [opção de subscrição] que daria à OpenAI uma participação de 10% na fabricante de chips se atingir determinados marcos.

“Esta parceria é um passo importante na construção da capacidade de compute necessária para realizar todo o potencial da IA”, disse Altman no comunicado que anunciou o acordo.

O fluxo circular de dinheiro é mais um elemento da aposta na infraestrutura de IA que ressalta sua escala, assim como seus riscos. Se o hype em torno da IA se mostrar fugaz — se mais poder de computação não se traduzir em modelos melhores, ou se o setor não conseguir encontrar mais formas de gerar receita —, os investimentos interligados podem amplificar o impacto negativo.

Mesmo os defensores da IA dizem que a matemática é desafiadora.

“Somos otimistas com isso em grande escala”, disse David Crawford, presidente da prática de tecnologia da Bain. “O ponto que estávamos tentando destacar é que é caro.”

Fonte: Business Insider

Traduzido via ChatGPT